Обзор методов классификации в машинном обучении с помощью Scikit-Learn

Авторизуйтесь

Обзор методов классификации в машинном обучении с помощью Scikit-Learn

Для машинного обучения на Python написано очень много библиотек. Сегодня мы рассмотрим одну из самых популярных — Scikit-Learn.

Scikit-Learn упрощает процесс создания классификатора и помогает более чётко выделить концепции машинного обучения, реализуя их с помощью понятной, хорошо документированной и надёжной библиотекой.

Что такое Scikit-Learn?

Scikit-Learn — это Python-библиотека, впервые разработанная David Cournapeau в 2007 году. В этой библиотеке находится большое количество алгоритмов для задач, связанных с классификацией и машинным обучением в целом.

Scikit-Learn базируется на библиотеке SciPy, которую нужно установить перед началом работы.

Основные термины

В системах машинного обучения или же системах нейросетей существуют входы и выходы. То, что подаётся на входы, принято называть признаками (англ. features).

Признаки по существу являются тем же, что и переменные в научном эксперименте — они характеризуют какой-либо наблюдаемый феномен и их можно как-то количественно измерить.

Когда признаки подаются на входы системы машинного обучения, эта система пытается найти совпадения, заметить закономерность между признаками. На выходе генерируется результат этой работы.

Этот результат принято называть меткой (англ. label), поскольку у выходов есть некая пометка, выданная им системой, т. е. предположение (прогноз) о том, в какую категорию попадает выход после классификации.

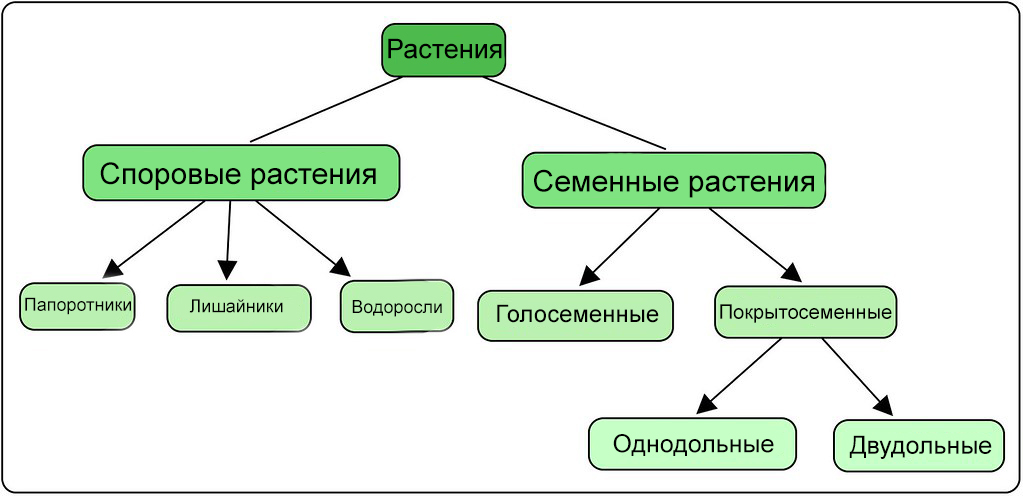

В контексте машинного обучения классификация относится к обучению с учителем. Такой тип обучения подразумевает, что данные, подаваемые на входы системы, уже помечены, а важная часть признаков уже разделена на отдельные категории или классы. Поэтому сеть уже знает, какая часть входов важна, а какую часть можно самостоятельно проверить. Пример классификации — сортировка различных растений на группы, например «папоротники» и «покрытосеменные». Подобная задача может быть выполнена с помощью Дерева Решений — одного из типов классификатора в Scikit-Learn.

При обучении без учителя в систему подаются непомеченные данные, и она должна попытаться сама разделить эти данные на категории. Так как классификация относится к типу обучения с учителем, способ обучения без учителя в этой статье рассматриваться не будет.

Процесс обучения модели — это подача данных для нейросети, которая в результате должна вывести определённые шаблоны для данных. В процессе обучения модели с учителем на вход подаются признаки и метки, а при прогнозировании на вход классификатора подаются только признаки.

Принимаемые сетью данные делятся на две группы: набор данных для обучения и набор для тестирования. Не стоит проверять сеть на том же наборе данных, на которых она обучалась, т. к. модель уже будет «заточена» под этот набор.

Типы классификаторов

Scikit-Learn даёт доступ ко множеству различных алгоритмов классификации. Вот основные из них:

На сайте Scikit-Learn есть много литературы на тему этих алгоритмов с кратким пояснением работы каждого из них.

Метод k-ближайших соседей (K-Nearest Neighbors)

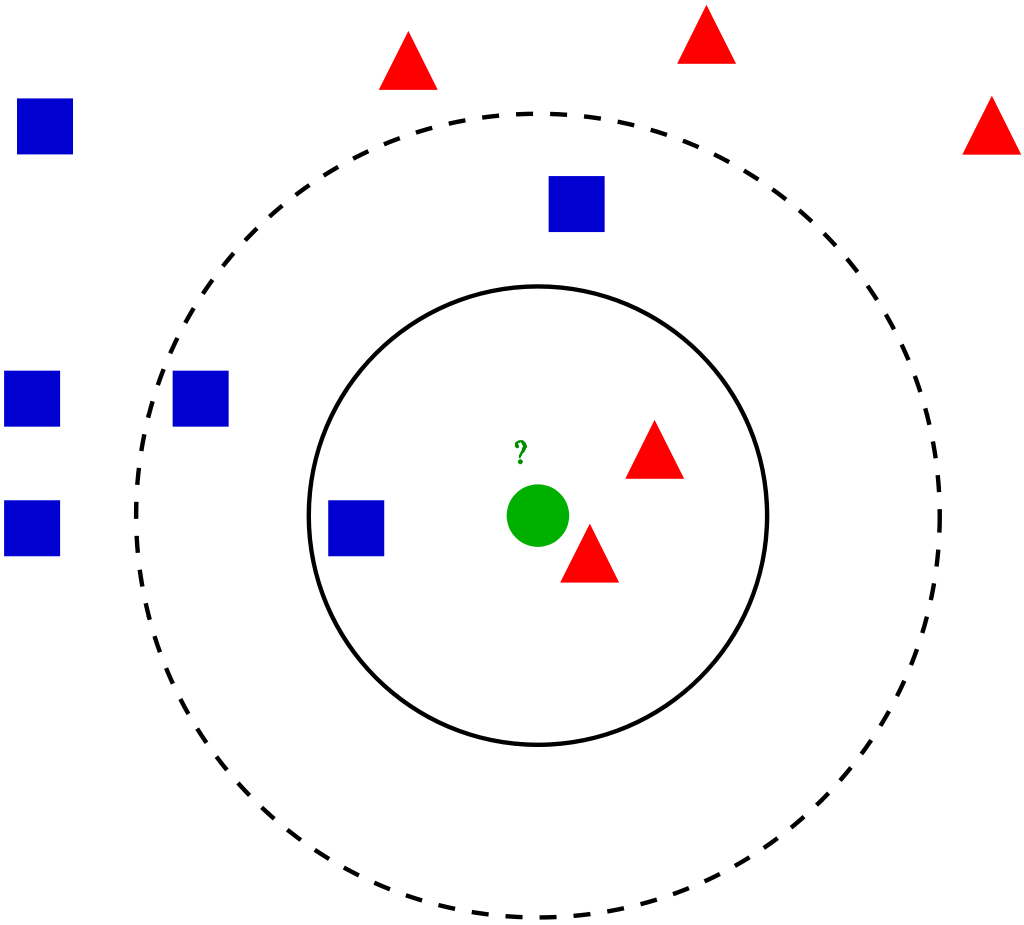

Этот метод работает с помощью поиска кратчайшей дистанции между тестируемым объектом и ближайшими к нему классифицированным объектами из обучающего набора. Классифицируемый объект будет относится к тому классу, к которому принадлежит ближайший объект набора.

Классификатор дерева решений (Decision Tree Classifier)

Этот классификатор разбивает данные на всё меньшие и меньшие подмножества на основе разных критериев, т. е. у каждого подмножества своя сортирующая категория. С каждым разделением количество объектов определённого критерия уменьшается.

Классификация подойдёт к концу, когда сеть дойдёт до подмножества только с одним объектом. Если объединить несколько подобных деревьев решений, то получится так называемый Случайный Лес (англ. Random Forest).

Наивный байесовский классификатор (Naive Bayes)

Такой классификатор вычисляет вероятность принадлежности объекта к какому-то классу. Эта вероятность вычисляется из шанса, что какое-то событие произойдёт, с опорой на уже на произошедшие события.

Каждый параметр классифицируемого объекта считается независимым от других параметров.

Линейный дискриминантный анализ (Linear Discriminant Analysis)

Этот метод работает путём уменьшения размерности набора данных, проецируя все точки данных на линию. Потом он комбинирует эти точки в классы, базируясь на их расстоянии от центральной точки.

Этот метод, как можно уже догадаться, относится к линейным алгоритмам классификации, т. е. он хорошо подходит для данных с линейной зависимостью.

Метод опорных векторов (Support Vector Machines)

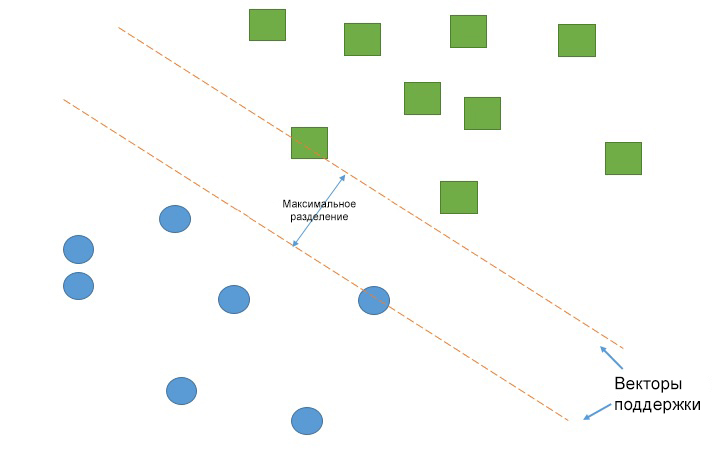

Работа метода опорных векторов заключается в рисовании линии между разными кластерами точек, которые нужно сгруппировать в классы. С одной стороны линии будут точки, принадлежащие одному классу, с другой стороны — к другому классу.

Классификатор будет пытаться увеличить расстояние между рисуемыми линиями и точками на разных сторонах, чтобы увеличить свою «уверенность» определения класса. Когда все точки построены, сторона, на которую они падают — это класс, которому эти точки принадлежат.

Логистическая регрессия (Logistic Regression)

У каждого признака есть своя метка, равная только 0 или только 1. Логистическая регрессия является линейным классификатором и поэтому используется, когда в данных прослеживается какая-то линейная зависимость.

Примеры задач классификации

Задача классификации — эта любая задача, где нужно определить тип объекта из двух и более существующих классов. Такие задачи могут быть разными: определение, кошка на изображении или собака, или определение качества вина на основе его кислотности и содержания алкоголя.

В зависимости от задачи классификации вы будете использовать разные типы классификаторов. Например, если классификация содержит какую-то бинарную логику, то к ней лучше всего подойдёт логистическая регрессия.

По мере накопления опыта вам будет проще выбирать подходящий тип классификатора. Однако хорошей практикой является реализация нескольких подходящих классификаторов и выбор наиболее оптимального и производительного.

Реализация классификатора

Первый шаг в реализации классификатора — его импорт в Python. Вот как это выглядит для логистической регрессии:

Вот импорты остальных классификаторов, рассмотренных выше:

Однако, это не все классификаторы, которые есть в Scikit-Learn. Про остальные можно прочитать на соответствующей странице в документации.

После этого нужно создать экземпляр классификатора. Сделать это можно создав переменную и вызвав функцию, связанную с классификатором.

Теперь классификатор нужно обучить. Перед этим нужно «подогнать» его под тренировочные данные.

Обучающие признаки и метки помещаются в классификатор через функцию fit :

Эти этапы (создание экземпляра, обучение и классификация) являются основными при работе с классификаторами в Scikit-Learn. Но эта библиотека может управлять не только классификаторами, но и самими данными. Чтобы разобраться в том, как данные и классификатор работают вместе над задачей классификации, нужно разобраться в процессах машинного обучения в целом.

Процесс машинного обучения

Процесс содержит в себе следующие этапы: подготовка данных, создание обучающих наборов, создание классификатора, обучение классификатора, составление прогнозов, оценка производительности классификатора и настройка параметров.

Во-первых, нужно подготовить набор данных для классификатора — преобразовать данные в корректную для классификации форму и обработать любые аномалии в этих данных. Отсутствие значений в данных либо любые другие отклонения — все их нужно обработать, иначе они могут негативно влиять на производительность классификатора. Этот этап называется предварительной обработкой данных (англ. data preprocessing).

Следующим шагом будет разделение данных на обучающие и тестовые наборы. Для этого в Scikit-Learn существует отличная функция traintestsplit.

Как уже было сказано выше, классификатор должен быть создан и обучен на тренировочном наборе данных. После этих шагов модель уже может делать прогнозы. Сравнивая показания классификатора с фактически известными данными, можно делать вывод о точности классификатора.

Вероятнее всего, вам нужно будет «корректировать» параметры классификатора, пока вы не достигните желаемой точности (т. к. маловероятно, что классификатор будет соответствовать всем вашим требованиям с первого же запуска).

Ниже будет представлен пример работы машинного обучения от обработки данных и до оценки.

Реализация образца классификации

Поскольку набор данных iris достаточно распространён, в Scikit-Learn он уже присутствует, достаточно лишь заложить эту команду:

Тем не менее, тут ещё нужно подгрузить CSV-файл, который можно скачать здесь.

Благодаря тому, что данные уже были подготовлены, долгой предварительной обработки они не требуют. Единственное, что может понадобиться — убрать ненужные столбцы (например ID ) таким образом:

Теперь нужно определить признаки и метки. С библиотекой Pandas можно легко «нарезать» таблицу и выбрать определённые строки/столбцы с помощью функции iloc() :

Код выше выбирает каждую строку и столбец, обрезав при этом последний столбец.

Выбрать признаки интересующего вас набора данных можно также передав в скобках заголовки столбцов:

После того, как вы выбрали нужные признаки и метки, их можно разделить на тренировочные и тестовые наборы, используя функцию train_test_split() :

Чтобы убедиться в правильности обработки данных, используйте:

Теперь можно создавать экземпляр классификатора, например метод опорных векторов и метод k-ближайших соседей:

Теперь нужно обучить эти два классификатора:

Эти команды обучили модели и теперь классификаторы могут делать прогнозы и сохранять результат в какую-либо переменную.

Теперь пришло время оценить точности классификатора. Существует несколько способов это сделать.

Нужно передать показания прогноза относительно фактически верных меток, значения которых были сохранены ранее.

Вот, к примеру, результат полученных метрик:

Поначалу кажется, что KNN работает точнее. Вот матрица неточностей для SVC:

Количество правильных прогнозов идёт с верхнего левого угла в нижний правый. Вот для сравнения метрики классификации для KNN:

Оценка классификатора

Когда дело доходит до оценки точности классификатора, есть несколько вариантов.

Точность классификации

Точность классификации измерять проще всего, и поэтому этот параметр чаще всего используется. Значение точности — это число правильных прогнозов, делённое на число всех прогнозов или, проще говоря, отношение правильных прогнозов ко всем.

Хоть этот показатель и может быстро дать вам явное представление о производительности классификатора, его лучше использовать, когда каждый класс имеет хотя бы примерно одинаковое количество примеров. Так как такое будет случаться редко, рекомендуется использовать другие показатели классификации.

Логарифмические потери

Значение Логарифмических Потерь (англ. Logarithmic Loss) — или просто логлосс — показывает, насколько классификатор «уверен» в своём прогнозе. Логлосс возвращает вероятность принадлежности объекта к тому или иному классу, суммируя их, чтобы дать общее представление об «уверенности» классификатора.

Этот показатель лежит в промежутке от 0 до 1 — «совсем не уверен» и «полностью уверен» соответственно. Логлосс сильно падает, когда классификатор сильно «уверен» в неправильном ответе.

Площадь ROC-кривой (AUC)

Такой показатель используется только при бинарной классификации. Площадь под ROC-кривой представляет способность классификатора различать подходящие и не подходящие какому-либо классу объекты.

Значение 1.0 : вся область, попадающая под кривую, представляет собой идеальный классификатор. Следовательно, 0.5 означает, что точность классификатора соответствует случайности. Кривая рассчитывается с учётом точности и специфичности модели. Подробнее о расчётах можно прочитать здесь.

Матрица неточностей

Матрица неточностей (англ. Confusion Matrix) — это таблица или диаграмма, показывающая точность прогнозирования классификатора в отношении двух и более классов. Прогнозы классификатора находятся на оси X, а результат (точность) — на оси Y.

Ячейки таблицы заполняются количеством прогнозов классификатора. Правильные прогнозы идут по диагонали от верхнего левого угла в нижний правый. Про это можно почитать в данной статье.

Отчёт о классификации

В библиотеке Scikit-Learn уже встроена возможность создавать отчёты о производительности классификатора. Эти отчёты дают интуитивно понятное представление о работе модели.

Заключение

Чтобы лучше вникнуть в работу с Scikit-Learn, неплохо было бы узнать больше о работе различных методов классификации. После этого стоит лучше узнать о замере производительности классификаторов. Однако понимание многих нюансов в классификации приходит только со временем.

Классификация (машинное обучение)

Классифика́ция — один из разделов машинного обучения, посвященный решению следующей задачи. Имеется множество «объектов » (ситуаций), разделённых некоторым образом на «классы «. Задано конечное множество объектов, для которых известно, к каким классам они относятся. Это множество называется «обучающей выборкой «. Классовая принадлежность остальных объектов не известна. Требуется построить алгоритм, способный классифицировать произвольный объект из исходного множества.

Классифици́ровать объект — значит, указать номер (или наименование класса), к которому относится данный объект.

Классифика́ция объекта — номер или наименование класса, выдаваемый алгоритмом классификации в результате его применения к данному конкретному объекту.

В математической статистике задачи классификации называются также задачами дискриминантного анализа.

В машинном обучении задача классификации относится к разделу обучения с учителем. Существует также обучение без учителя, когда разделение объектов обучающей выборки на классы не задаётся, и требуется классифицировать объекты только на основе их сходства друг с другом. В этом случае принято говорить о задачах кластеризации или таксономии, и классы называть, соответственно, кластерами или таксонами. В некоторых прикладных областях, и даже в самой математической статистике, существует тенденция называть задачи кластеризации задачами классификации.

Типология задач классификации

Типы входных данных

* Признаковое описание — наиболее распространённый случай. Каждый объект описывается набором своих характеристик, называемых «признаками «. Признаки могут быть числовыми или нечисловыми.

* Матрица расстояний между объектами. Каждый объект описывается расстояниями до всех остальных объектов обучающей выборки. С этим типом входных данных работают немногие методы, в частности, метод ближайших соседей, метод парзеновского окна, метод потенциальных функций.

* Временной ряд или сигнал представляет собой последовательность измерений во времени. Каждое измерение может представляться числом, вектором, а в общем случае — признаковым описанием исследуемого объекта в данный момент времени.

* Изображение или видеоряд.

* Встречаются и более сложные случаи, когда входные данные представляются в виде графов, текстов, результатов запросов к базе данных, и т. д. Как правило, они приводятся к первому или второму случаю путём предварительной обработки данных и извлечения признаков.

Классификацию сигналов и изображений называют также распознаванием образов.

Типы классов

* Двухклассовая классификация. Наиболее простой в техническом отношении случай, который служит основой для решения более сложныхзадач.

* Многоклассовая классификация. Когда число классов достигает многих тысяч (например, при распознавании иероглифов или слитной речи), задача классификации становится существенно более трудной.

* Непересекающиеся классы.

* Пересекающиеся классы. Объект может относиться одновременно к нескольким классам.

* Нечёткие классы. Требуется определять степень принадлежности объекта каждому из классов, обычно это действительное число от 0 до 1.

Классификация: формальная постановка

— множество описаний объектов, Y

Вероятностная постановка задачи

Признаковое пространство

«Признаком » называется отображение fcolon X o D_f

— множество допустимых значений признака. Если заданы признаки f_1,dots,f_n

В зависимости от множества D_f признаки делятся на следующие типы:

* «бинарный » признак: D_f= <0,1>;

* «номинальный » признак: D_f — конечное множество;

* «порядковый » признак: D_f — конечное упорядоченное множество;

* «количественный » признак: D_f — множество действительных чисел.

Часто встречаются прикладные задачи с разнотипными признаками, для их решения подходят далеко не все методы.

Примеры прикладных задач

Задачи медицинской диагностики

В роли объектов выступают пациенты.Признаки характеризуют результаты обследований, симптомы заболеванияи применявшиеся методы лечения.Примеры бинарных признаков:пол, наличие головной боли, слабости.Порядковый признак — тяжесть состояния(удовлетворительное, средней тяжести, тяжёлое, крайне тяжёлое).Количественные признаки —возраст, пульс, артериальное давление,содержание гемоглобина в крови, доза препарата.Признаковое описание пациента является, по сути дела,формализованной историей болезни.Накопив достаточное количество прецедентов в электронном виде,можно решать различные задачи:

* классифицировать вид заболевания (дифференциальная диагностика);

* определять наиболее целесообразный способ лечения;

* предсказывать длительность и исход заболевания;

* оценивать риск осложнений;

* находить синдромы — наиболее характерные для данного заболевания совокупности симптомов.

Ценность такого рода систем в том, что они способны мгновенноанализировать и обобщать огромное количество прецедентов —возможность, недоступная специалисту-врачу.

Предсказание месторождений полезных ископаемых

Признаками являются данные геологической разведки.Наличие или отсутствие тех или иных пород на территории районакодируется бинарными признаками.Физико-химические свойства этих пород могут описыватьсякак количественными, так и качественными признаками.Обучающая выборка составляется из прецедентов двух классов:районов известных месторожденийи похожих районов, в которых интересующее ископаемое обнаружено не было.При поиске редких полезных ископаемыхколичество объектов может оказаться намного меньше,чем количество признаков.В этой ситуации плохо работают классические статистические методы.Задача решается путёмпоиска закономерностей в имеющемся массиве данных.В процессе решения выделяются короткие наборы признаков,обладающие наибольшей информативностью —способностью наилучшим образом разделять классы.По аналогии с медицинской задачей,можно сказать, что отыскиваются «синдромы» месторождений.Это важный побочный результат исследования,представляющий значительный интерес для геофизиков и геологов.

Оценивание кредитоспособности заёмщиков

Эта задача решается банками при выдаче кредитов.Потребность в автоматизации процедуры выдачи кредитов впервые возниклав период бума кредитных карт 60-70-х годов в США и других развитых странах.Объектами в данном случае являются физические или юридические лица, претендующие на получение кредита.В случае физических лиц признаковое описание состоит из анкеты,которую заполняет сам заёмщик, и, возможно, дополнительной информации,которую банк собирает о нём из собственных источников.Примеры бинарных признаков: пол, наличие телефона.Номинальные признаки — место проживания, профессия, работодатель.Порядковые признаки — образование, занимаемая должность.Количественные признаки — сумма кредита, возраст, стаж работы, доход семьи,размер задолженностей в других банках.Обучающая выборка составляется из заёмщиков с известной кредитной историей.В простейшем случае принятие решенийсводится к классификации заёмщиков на два класса:«хороших» и «плохих».Кредиты выдаются только заёмщикам первого класса.В более сложном случае оценивается суммарное число баллов (scoreref-en) заёмщика,набранных по совокупности информативных признаков.Чем выше оценка, тем более надёжным считается заёмщик.Отсюда и название — кредитный скоринг.На стадии обучения производится синтез и отбор информативных признакови определяется, сколько баллов назначать за каждый признак,чтобы риск принимаемых решений был минимален.Следующая задача — решить, на каких условиях выдавать кредит:определить процентную ставку, срок погашения,и прочие параметры кредитного договора.Эта задача также может быть решения методами обучения по прецедентам.

Предсказание оттока клиентов

Оптическое распознавание символов

Распознавание речи

Обнаружение спама

Классификация документов

Методы решения

* Байесовский классификатор:

** квадратичный классификатор;

** линейный дискриминант Фишера;

** наивный байесовский классификатор;

** метод парзеновского окна;

** разделение смеси вероятностных распределений (EM-алгоритм);

** метод потенциальных функций или метод радиальных базисных функций;

** метод ближайших соседей.

* Нейронная сеть:

** персептрон;

** многослойный персептрон;

** гибридная сеть встречного распространения;

* Линейный разделитель:

** линейный дискриминант Фишера;

** наивный байесовский классификатор;

** однослойный персептрон;

** логистическая регрессия;

** машина опорных векторов.

* Индукция правил:

** решающее дерево;

** решающий список;

** решающий лес;

** тестовый алгоритм;

** алгоритм вычисления оценок.

* Алгоритмическая композиция:

** взвешенное голосование;

** бустинг;

** бэггинг;

** метод комитетов;

** смесь экспертов.

* Сокращение размерности:

** селекция признаков;

** метод главных компонент;

** метод независимых компонент;

** многомерное шкалирование.

* Выбор модели:

** минимизация эмпирического риска;

** структурная минимизация риска;

** минимум длины описания;

** скользящий контроль;

** извлечение признаков

** самоорганизация моделей;

** случайный поиск с адаптацией;

** генетический алгоритм.

Ссылки

Литература

# «Айвазян С. А., Бухштабер В. М., Енюков И. С., Мешалкин Л. Д. » Прикладная статистика: классификация и снижение размерности. — М.: Финансы и статистика, 1989.

# «Вапник В. Н. » Восстановление зависимостей по эмпирическим данным. — М.: Наука, 1979.

# «Журавлев Ю. И., Рязанов В. В., Сенько О. В. » «Распознавание». Математические методы. Программная система. Практические применения. — М.: Фазис, 2006. ISBN 5-7036-0108-8.

# «Загоруйко Н. Г. » Прикладные методы анализа данных и знаний. — Новосибирск: ИМ СО РАН, 1999. ISBN 5-86134-060-9.

# «Шлезингер М., Главач В. » Десять лекций по статистическому и структурному распознаванию. — Киев: Наукова думка, 2004. ISBN 966-00-0341-2.

# «Hastie T., Tibshirani R., Friedman J. » The Elements of Statistical Learning. — Springer, 2001. ISBN 0-387-95284-5.

# «Mitchell T. » Machine Learning. — McGraw-Hill Science/Engineering/Math, 1997. ISBN 0-07-042807-7.

Категории

Обучение машин — Машинное обучение (англ. Machine Learning) обширный подраздел искусственного интеллекта, изучающий методы построения алгоритмов, способных обучаться. Различают два типа обучения. Обучение по прецедентам, или индуктивное обучение, основано на… … Википедия

Обучение по прецедентам — Машинное обучение (англ. Machine Learning) обширный подраздел искусственного интеллекта, изучающий методы построения алгоритмов, способных обучаться. Различают два типа обучения. Обучение по прецедентам, или индуктивное обучение, основано на… … Википедия

Обучение без учителя — (англ. Unsupervised learning, самообучение, спонтанное обучение) один из способов машинного обучения, при решении которых испытуемая система спонтанно обучается выполнять поставленную задачу, без вмешательства со стороны… … Википедия

Обучение на примерах — (англ. Learning from Examples) вид обучения, при котором интеллектуальной системе предъявляется набор положительных и отрицательных примеров, связанных с какой либо заранее неизвестной закономерностью. В интеллектуальных системах… … Википедия

Обучение ранжированию — (англ. learning to rank или machine learned ranking, MLR)[1] это класс задач машинного обучения с учителем, заключающихся в автоматическом подборе ранжирующей модели по обучающей выборке, состоящей из множества списков и заданных… … Википедия

Универсальная десятичная классификация — Запрос « УДК » перенаправляется сюда; см. также другие значения. Универсальная десятичная классификация (УДК) система классификации информации, широко используется во всем мире для систематизации произведений науки, литературы и… … Википедия

Искусственная нейронная сеть — У этого термина существуют и другие значения, см. Нейронная сеть (значения). Схема простой нейросети. Зелёным цветом обозначены входные нейроны, голубым скрытые нейроны, жёлтым выходной нейрон … Википедия

Искусственный интеллект — Запрос «ИИ» перенаправляется сюда; см. также другие значения. Искусственный интеллект (ИИ, англ. Artificial intelligence, AI) наука и технология создания интеллектуальных машин, особенно интеллектуальных компьютерных программ. ИИ… … Википедия

Искусственная нейросеть — Запрос «Нейронная сеть» перенаправляется сюда. Cм. также другие значения. Схема простой нейросети. Зелёным обозначены входные элементы, жёлтым выходной элемент Искусственные нейронные сети (ИНС) математические модели, а также их программные или… … Википедия